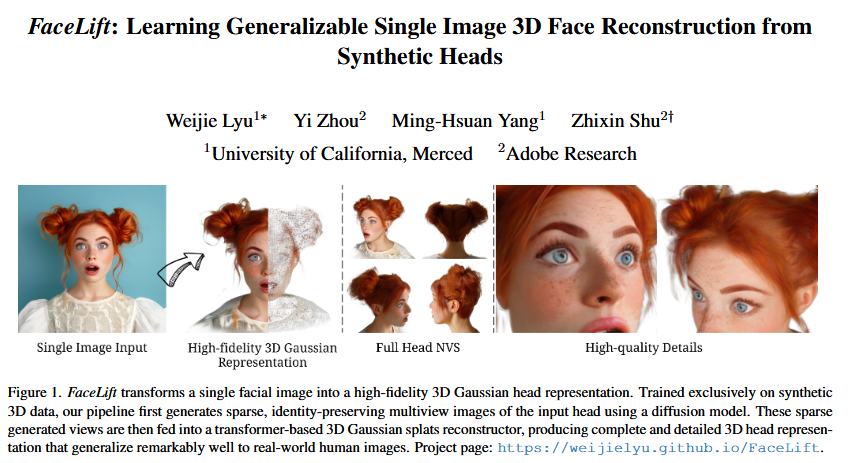

こんにちは。今回は、ICCV 2025に採択された「FaceLift: Learning Generalizable Single Image 3D Face Reconstruction from Synthetic Heads」という最新の研究を紹介したいと思います。

論文 : https://arxiv.org/abs/2412.17812

github : https://github.com/weijielyu/FaceLift

この手法は、1枚の顔写真から高品質な3D頭部モデルを自動生成できるというもので、その完成度の高さに驚きました。感動です。実装をクローンして動かしてみた結果も一緒に共有します。

FaceLiftとは

FaceLiftは、カリフォルニア大学マーセッド校とAdobe Researchの研究チームによって開発された、単一画像からの3D顔復元手法です。

何ができるのか

簡潔に言えば:

1枚の正面からの顔画像 → 360度回転可能な高品質な3D頭部モデル

従来の3D顔復元手法は、正面だけの情報に限定されていたり、マルチビュー画像が必要だったりしましたが、FaceLiftはこれらの制限を大きく改善しています。

主な特徴

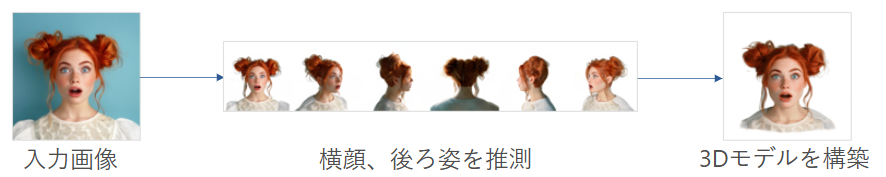

1. マルチビュー潜在拡散モデル(Multi-view Latent Diffusion Model)

FaceLiftの最初のステップは、1枚の入力画像から、側面(side view)や背面(back view)といった複数視点の画像を一貫性を保ちながら生成することです。

これには潜在拡散モデルが使用されており、Era3Dなどの既存研究の知見も活用されています。重要なのは、生成された側面・背面画像が:

- 入力画像と矛盾しない

- 3D幾何学的に一貫している

という2つの制約を満たしていることです。

2. Transformer ベースの3D再構成器

生成された複数視点の画像を、直接的に3D Gaussian Splatsという表現に変換します。

3D Gaussian Splatsは最近のニューラル3D表現の中でも特に高速で高品質のレンダリングを実現する手法として注目されています。GS-LRMという基盤技術を活用しながら、顔専用にチューニングされています。

3. 合成データセットによる訓練

ここが本当に優れている点なのですが、FaceLiftは合成で生成した3D頭部モデルのみで訓練されています。

実在の人物データは使用していないのに、実世界の顔画像に対して高い精度で機能します。これは以下の工夫によって実現されています:

- ドメインギャップの埋め込み:出力の側面・背面画像を再び入力画像として復元できるかどうかを検証する「再構成ロス」を導入

- 高品質な合成データセット:現実的な照明やテクスチャを持つ合成3D頭部モデル

技術の深掘り

パイプライン全体

入力画像(正面顔)

↓

[ステップ1] マルチビュー拡散モデル

→ 側面、背面などの一貫した画像を生成

↓

[ステップ2] 3D再構成器(Transformer + GS-LRM)

→ 3D Gaussian Splats表現に変換

↓

出力:360度回転可能な3D頭部モデル

なぜ合成データだけで上手くいくのか

この質問に対して、論文のアプローチは以下の通りです:

- 合成データの利点活用:

- 完全なグラウンドトゥルース(正解の3D形状)が得られる

- 無限にバリエーションを生成できる

- アノテーション作業が不要

- ドメイン適応:

- マルチビュー生成時に、生成画像の左右対称性や親密な幾何学的制約を課す

- 入力画像との一貫性を強制する再構成ロスを使用

- 現実的な合成データセット:

- 単なる3Dモデルではなく、照明やテクスチャが現実的

- 顔表情のバリエーションも含まれている

セットアップと使い方

環境構築

FaceLiftはGitHubで公開されており、簡単にセットアップできます:

git clone https://github.com/weijielyu/FaceLift.git

cd FaceLift

bash setup_env.sh

スクリプトを実行すると、PyTorchなどの必要なライブラリが自動的にインストールされます。モデルウェイトはHugging Faceから初回実行時に自動ダウンロードされるため、別途ダウンロードの手間は不要です。

推論の実行

CLI による推論

ディレクトリ内の画像を一括処理する場合:

python inference.py --input_dir examples/ --output_dir outputs/

主要なオプション:

--auto_crop:顔を自動的に検出・クロップ(デフォルト:有効)--seed:再現性のためのシード値(デフォルト:4)--guidance_scale_2D:マルチビュー生成の制御強度(デフォルト:3.0)--step_2D:拡散モデルのステップ数(デフォルト:50)

Web インターフェース

より手軽に試したい場合は、Gradioを使ったWebインターフェースが利用できます:

python gradio_app.py

ブラウザで http://localhost:7860 にアクセスすると、画像をアップロードして結果を確認できます。

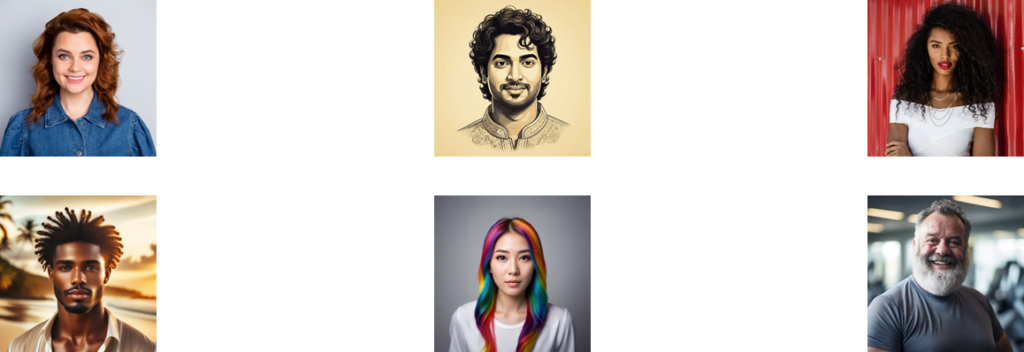

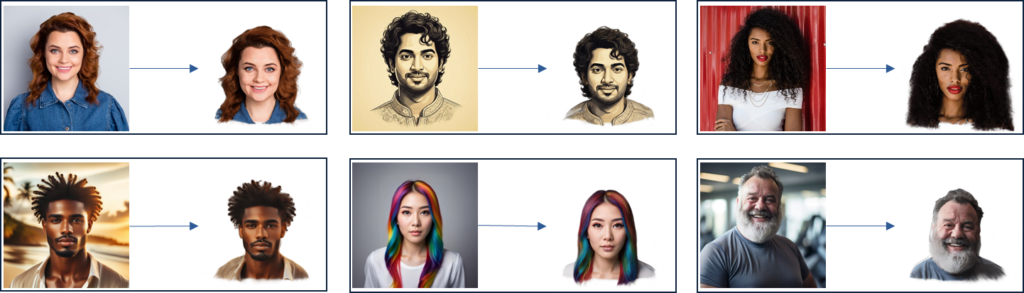

実装して動かしてみた

では、実際に私がFaceLiftをクローンして動かしてみました。

環境情報

- GPU:NVIDIA TITAN RTX

- CUDA バージョン:12.9

- 処理時間:一枚の画像の推論が1分未満

入力画像

repository内にあるサンプル画像を入力として動かしました。

実行結果

outputs/ ディレクトリには以下のファイルが生成されます:

- 3D モデルファイル(

.ply形式):3Dスキャナーなどで利用可能 - 複数視点のレンダリング画像:マルチビュー拡散で生成された側面・背面画像

- その他の中間結果

定性評価

実際に動かしてみて感じたポイント:

✅ 優れていた点

- 正面画像から側面・背面が自然に生成される

- 髪の毛の質感が想像以上に再現されている

- 顔のディテール(眉、目元など)が保持されている

- セットアップが簡単で、特別な前処理が不要

⚠️ 注意点

- 照明が極端に異なる画像は精度が低下する可能性

- 顔が大きく横向きの場合は結果が不安定になることがある

- 背景がシンプルな画像の方が良い結果が得られる

- サンプル画像にはないがスキンヘッドの生成は後頭部に髪が生成される

応用例

FaceLiftが生成した3D頭部モデルは、以下のような用途に活用できます:

1. バーチャルアバター生成

メタバース、VRチャット、ゲームなどでの使用。1枚の写真からキャラクター化が可能。

2. 顔認証・バイオメトリクス

複数視点での顔情報が得られるため、より堅牢な顔認証システムへの応用。

3. 3D 顔モーフィング

複数の顔から中間的な顔を生成するなど、表情や形状の補間に利用。

4. コンピュータ・グラフィックス

映画・ゲーム制作での顔モデルアセット生成。スキャン費用の削減。

5. 医療・美容分野

矯正前後の顔形状の可視化、シミュレーション。

既存手法との比較

従来の3D顔復元手法の課題

従来の手法には以下のような制限がありました:

| 手法 | 単一画像 | マルチビュー | 全体的形状 | 汎化性 |

|---|---|---|---|---|

| 従来の非ニューラル法 | ○ | × | △ | △ |

| ニューラルサイレン法 | ○ | △ | △ | △ |

| FaceLift | ○ | ○(生成) | ◎ | ◎ |

FaceLiftの革新性は:

- 単一画像入力:セットアップが簡単

- マルチビュー生成:360度の形状情報を取得

- 高い汎化性:合成データのみで実世界に機能

技術的な深掘り:なぜ上手くいくのか

1. マルチビュー制約

単に各視点の画像を独立に生成するのではなく、以下の制約を課しています:

最小化する損失 = 再構成誤差 + 拡散誤差 + 幾何学的一貫性誤差

特に「再構成誤差」(入力画像を復元できるかどうか)が重要で、これにより:

- 生成された側面・背面が入力の顔と矛盾しない

- テクスチャやアイデンティティが保持される

2. 合成データセットの活用

研究チームが作成した合成頭部データセットの特徴:

- 高フィデリティ:実写にと区別がつかないほどのクオリティ

- 多様性:年齢、性別、肌色など様々なバリエーション

- キャリブレーション済み:カメラパラメータが正確に記録されている

3. Transformer ベース設計の利点

GS-LRM の Transformer アーキテクチャを採用した理由:

- 大域的な文脈を考慮できる(全体的な頭部形状の理解)

- 効率的:CNNより少ないパラメータで高い表現力

- スケーラビリティ:解像度を上げるのが容易

ライセンスと利用規約

重要な注意点として:

- コード:Apache-2.0 ライセンス(商用利用可)

- モデルウェイト:Adobe Research License(研究目的での使用が主流)

研究・学習目的では自由に使用できますが、商用利用を検討する場合はAdobeに確認しましょう。

今後の展開と関連研究

FaceCam

著者らは最近、FaceLiftをベースにした FaceCam という後続研究を公開しました。これは生成した3D頭部を使用して、ポートレートビデオの仮想カメラ制御を行うものです。

つまり:顔写真 → 3D頭部 → ビデオカメラの制御 という一連のパイプラインです。

他の関連研究

FaceLiftは以下の研究の知見を活用しています:

- Era3D:マルチビュー画像生成

- GS-LRM:3D Gaussian Splatsベースの再構成

逆に、FaceLiftの成果は、以下の領域に影響を与える可能性があります:

- 単一画像からの3D人体復元

- 動物の3D形状復元

- ロボットビジョン

まとめ

FaceLiftの素晴らしいところをまとめると:

- シンプルながら強力:1枚の画像で完全な3D頭部を生成

- 実用的:セットアップが簡単で、実際に動く

- 学術的に興味深い:合成データのみで実世界に汎化するアプローチ

- オープンソース:GitHubで完全に公開されている

3D顔認識、バーチャルアバター、メタバース関連のプロジェクトに関わっている方にとって、このFaceLiftは確実に注目の価値がある技術です。

研究論文はarXiv:2412.17812で公開されており、実装はGitHub – weijielyu/FaceLiftで利用可能です。興味のある方はぜひクローンして試してみてください。

参考リンク

- 論文:FaceLift: Learning Generalizable Single Image 3D Face Reconstruction from Synthetic Heads

- GitHub:weijielyu/FaceLift

- プロジェクトページ:https://weijielyu.github.io/FaceLift

- デモ:Hugging Face Space

引用

@InProceedings{Lyu_2025_ICCV,

author = {Lyu, Weijie and Zhou, Yi and Yang, Ming-Hsuan and Shu, Zhixin},

title = {FaceLift: Learning Generalizable Single Image 3D Face Reconstruction from Synthetic Heads},

booktitle = {Proceedings of the IEEE/CVF International Conference on Computer Vision (ICCV)},

month = {October},

year = {2025},

pages = {12691-12701}

}

コメント